Интернет уже давно перестал быть пространством только для реальных людей — миллионы аккаунтов контролируются автоматизированными программами, такими как боты. Боты это не просто безобидные компьютерные программы, они представляют собой невидимую армию, которая может распространять ложную информацию, манипулировать общественным мнением, искусственно усиливать некоторые нарративы или манипулировать эмоциями пользователей интернета. Пользователи могут столкиваться с ботами, которые выглядят как реальные аккаунты, но они запрограммированы на имитацию человеческой деятельности. Вот почему очень важно знать, что такое боты, как они работают и как не попасть в их ловушку.

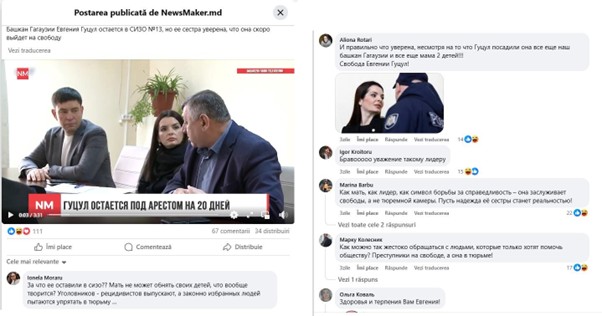

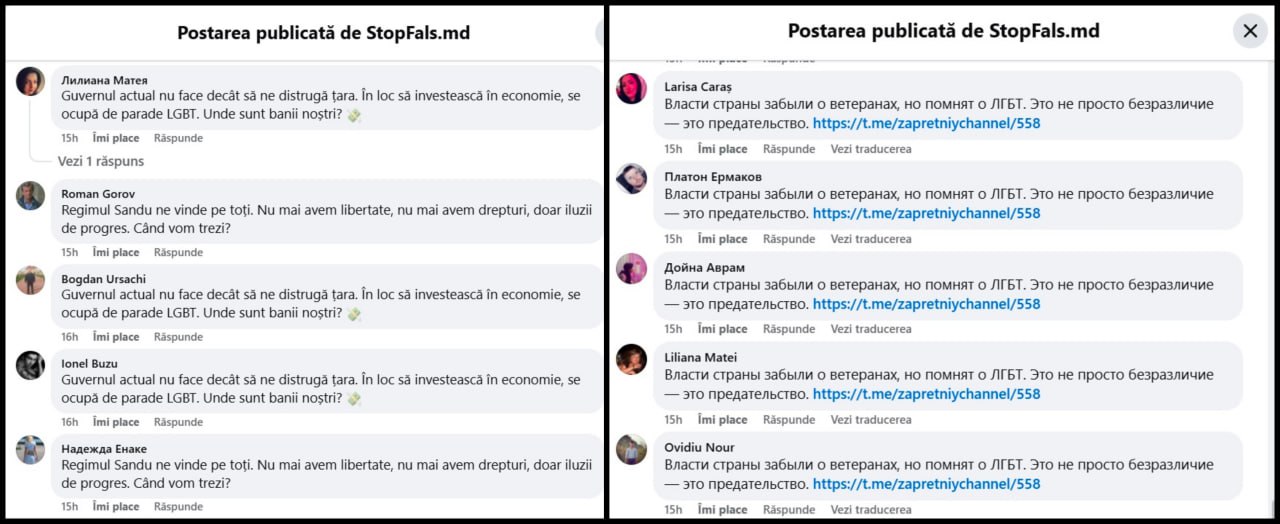

Некоторые посты на странице в Facebook портала Stopfals.md набирают десятки и сотни комментариев. Например, пост о том, как несколько Telegram-каналов, известных распространением кремлевской пропаганды, были наводнены ботами с комментариями на темы, не имеющими никакого отношения к сюжету самого поста.

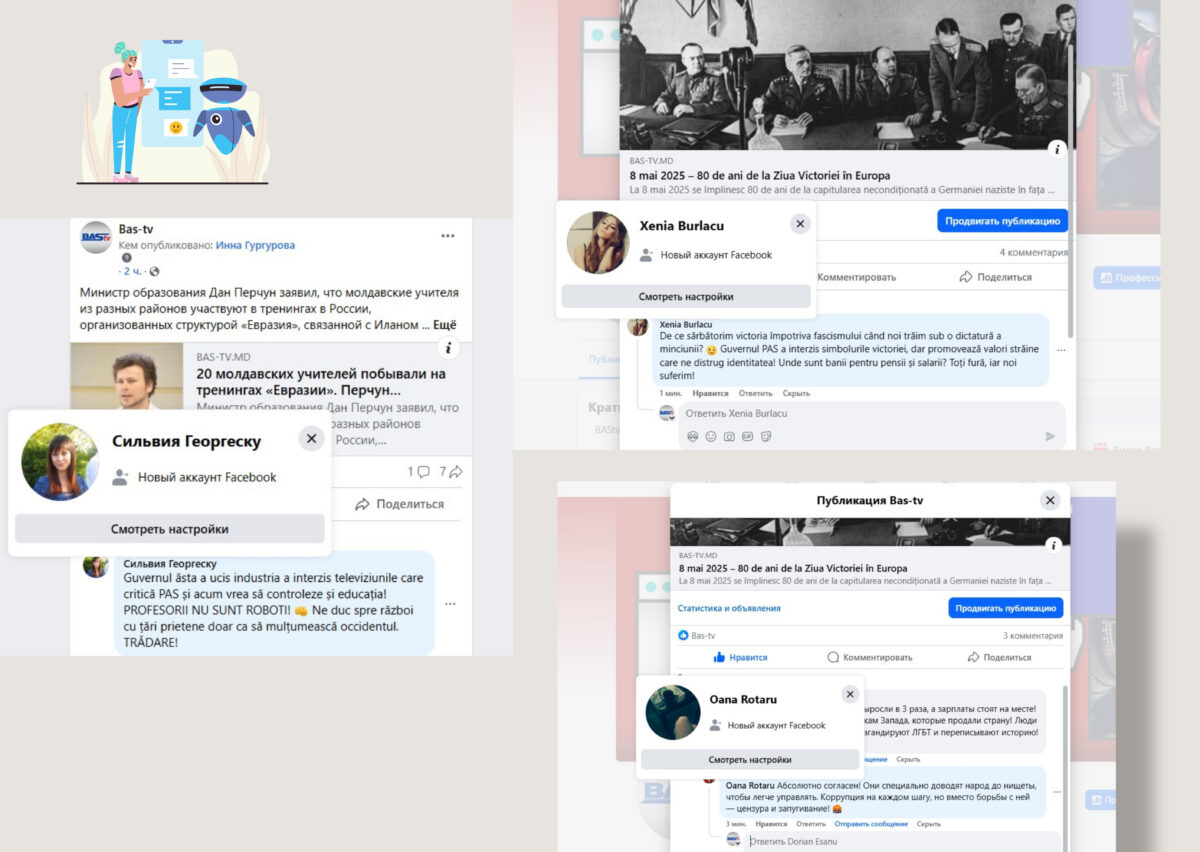

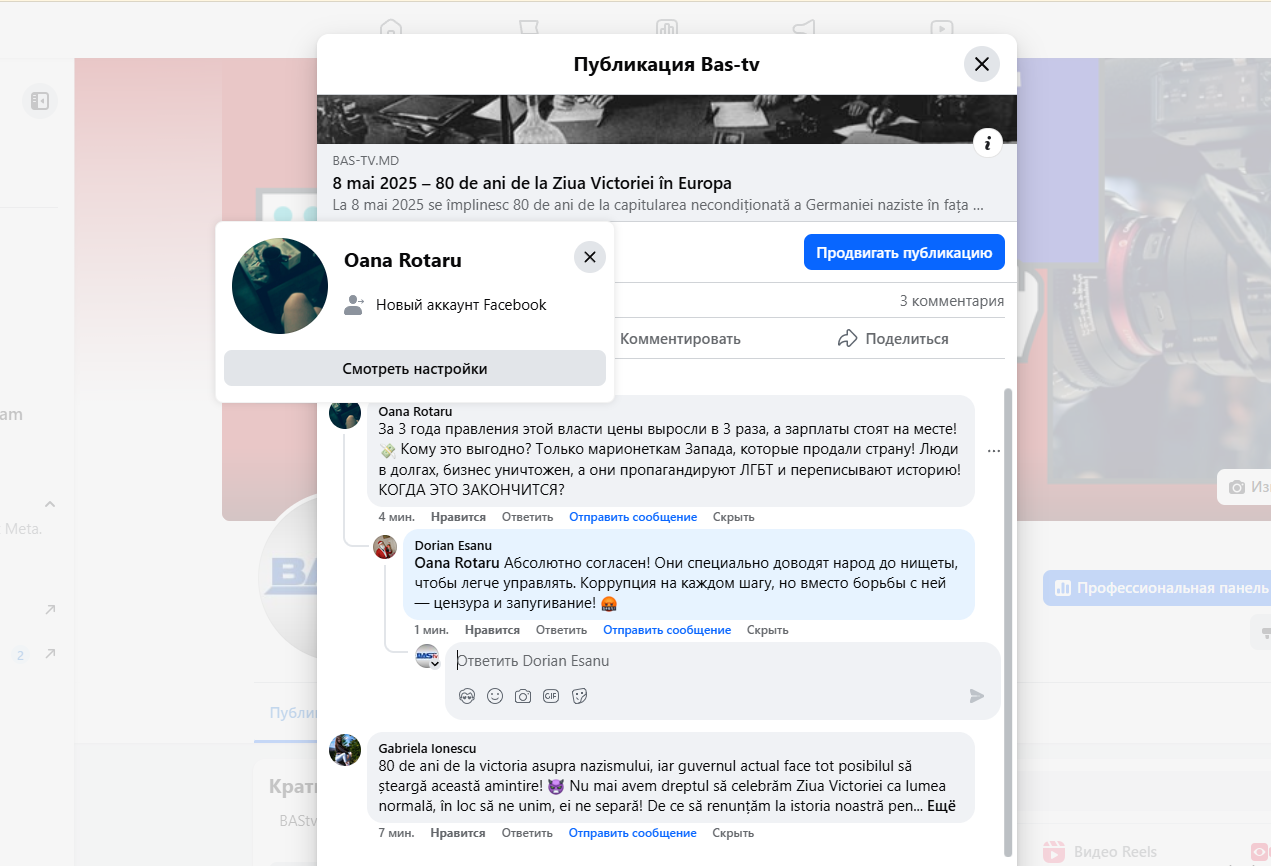

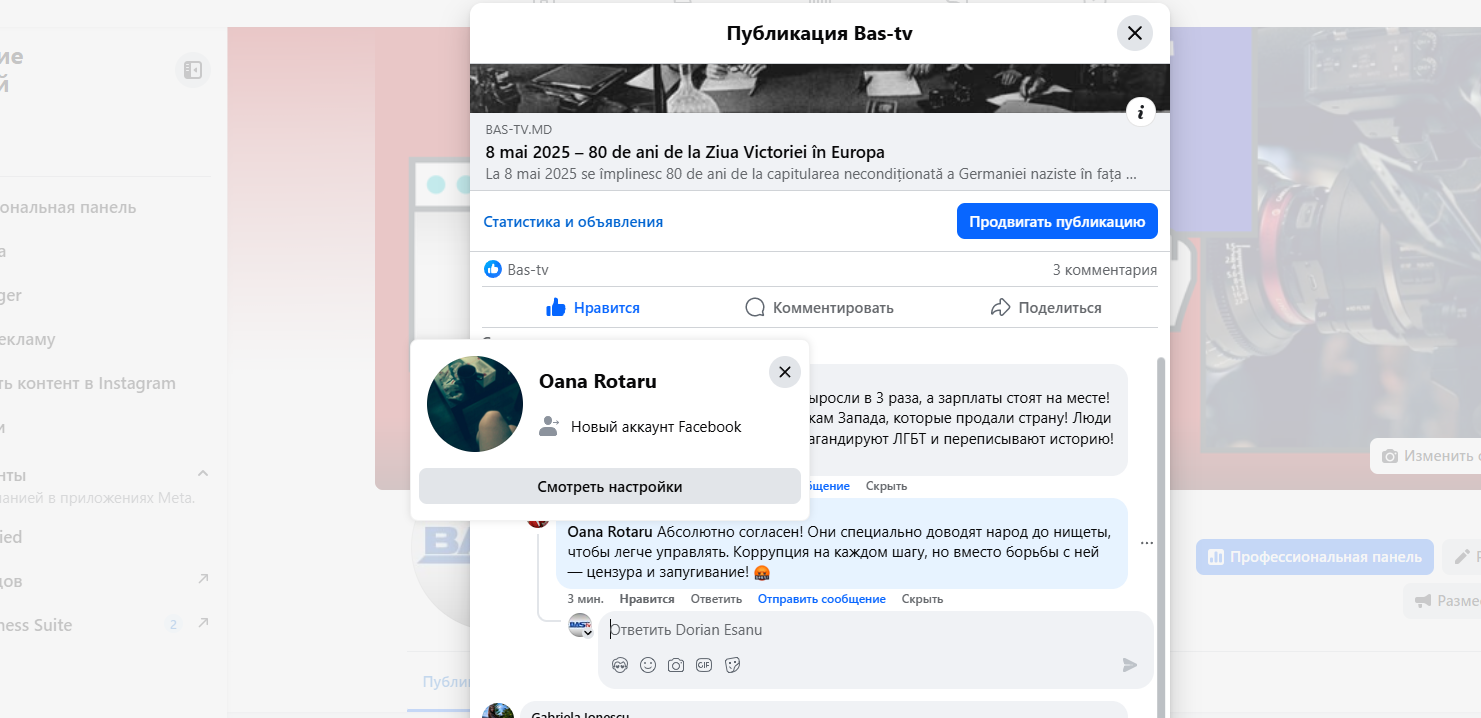

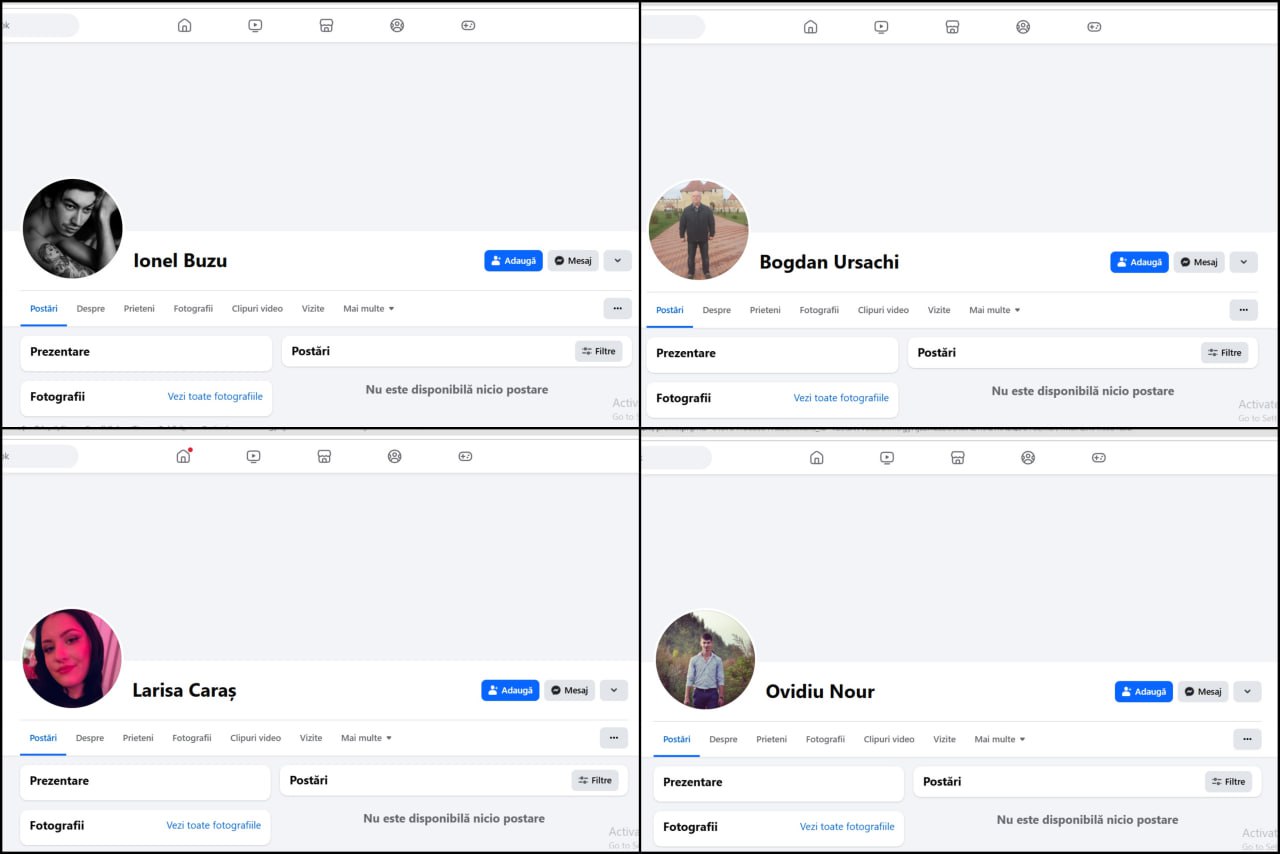

«Парламентское большинство превращает Молдову в полигон для экспериментов Запада. Где наши традиции? Где наша память о войне?», — пишет аккаунт Livia Lăcătuș с фотографией профиля в виде чаши, взятой из интернета, и без единого поста. Аналогичное сообщение запущено и с аккаунтов без постов Gabriela Hariton и Barbu Bădărău. «Нынешнее правительство только и делает, что разрушает нашу страну. Вместо того, чтобы инвестировать в экономику, занимается ЛГБТ-парадами. Где наши деньги?» (в оригинале: «Guvernul actual nu face decât să ne distrugă țara. În loc să investească în economie, se ocupă de parade LGBT. Unde sunt banii noștri?»), — пишет аккаунт Лилиана Матея, причем сообщение повторяется и аккаунтами без какой-либо деятельности Ionel Buzu и Bogdan Ursachi. «Власти страны забыли о ветеранах, но помнят о ЛГБТ. Это не просто безразличие — это предательство», — пишут несколько других аккаунтов (Larisa Caraș, Платон Ермаков, Дойна Аврам, Liliana Matei, Ovidiu Nour), а комментарий сопровождается ссылкой на пост Telegram-канала Запрещенный Канал, в котором цитируется высказывание беглого олигарха Илана Шора о марше ЛГБТ-сообщества от 15 июня.

Эта серия комментариев — классический пример ботовского поведения и онлайн-операции по оказанию влияния. Комментарии, скопированные слово в слово, повторяются разными «пользователями», со стоковыми или стандартными фотографиями профиля и полным отсутствием постов. Посты размещаются массово за короткий промежуток времени, что свидетельствует о синхронизированной активности, призванной создать впечатление, что мнение из комментариев якобы пользуется широкой поддержкой. В сообщениях используются одни и те же нарративы, которые представляются искаженно: ЛГБТ, правительство, традиции, 9 мая.

Наводнением публичного пространства пропагандистскими тезисами преследуется цель затмить реальные голоса и направить внимание на идеи, продвигаемые определенными заинтересованными сторонами, или на ложные либо искаженные темы. Навязчивое повторение одних и тех же нарративов и сихронизация их опубликования — специфические признаки сетей ботов (так называемых ботнетов – прим. ред.) В отмеченном выше случае включение ссылок на пост, в котором цитируется Илан Шор, усиливает фейки о ЛГБТ-сообществе. Таким образом, целью этих действий, характерных для ботов, является не выражение реального мнения, а манипулирование общественным восприятием, поляризация общества, распространение пропаганды и дезинформации.

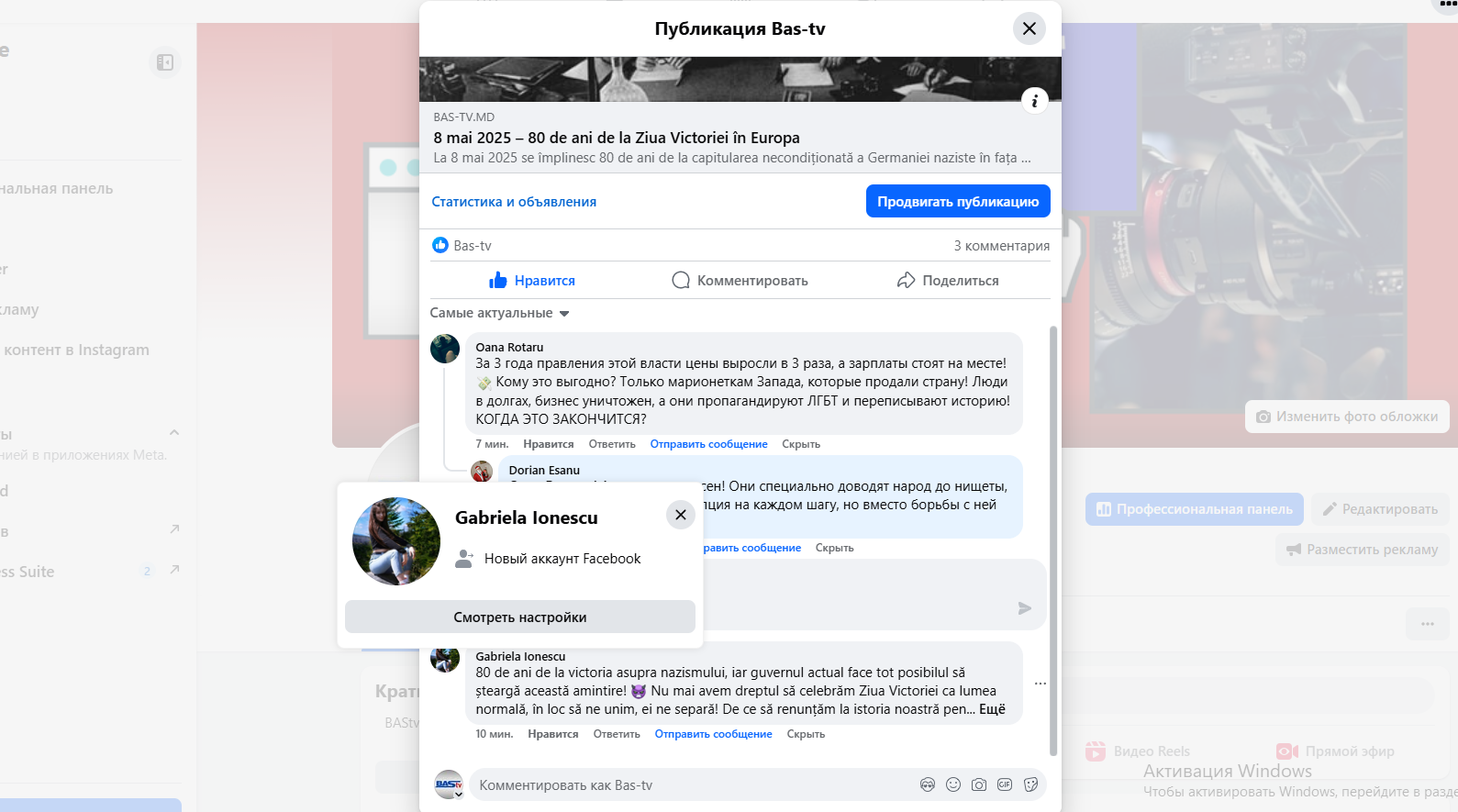

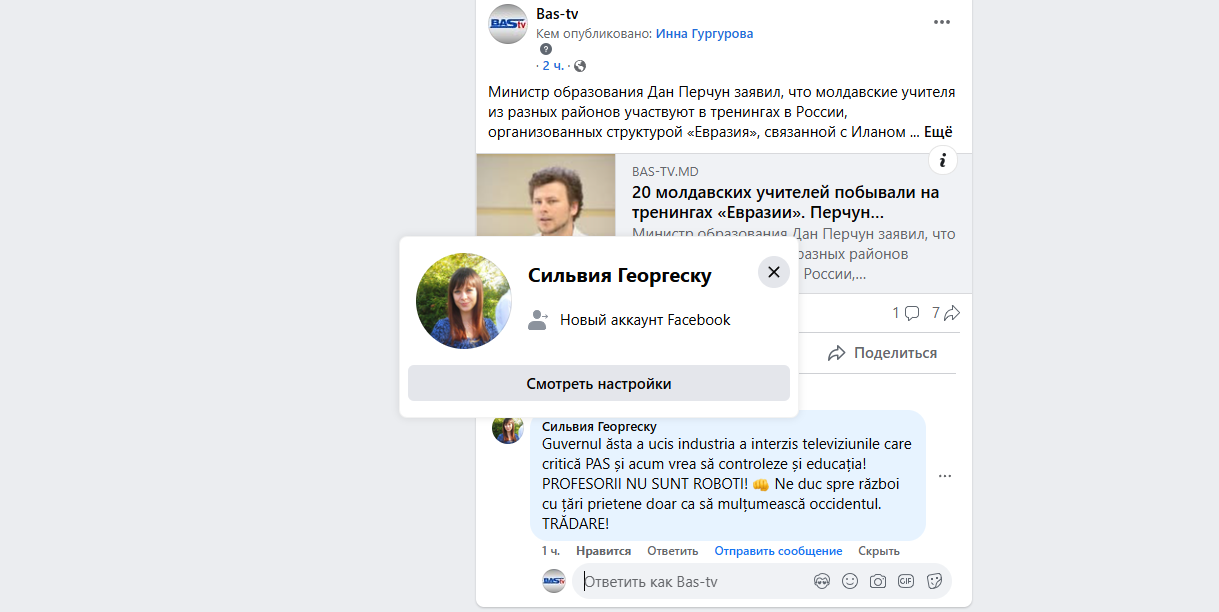

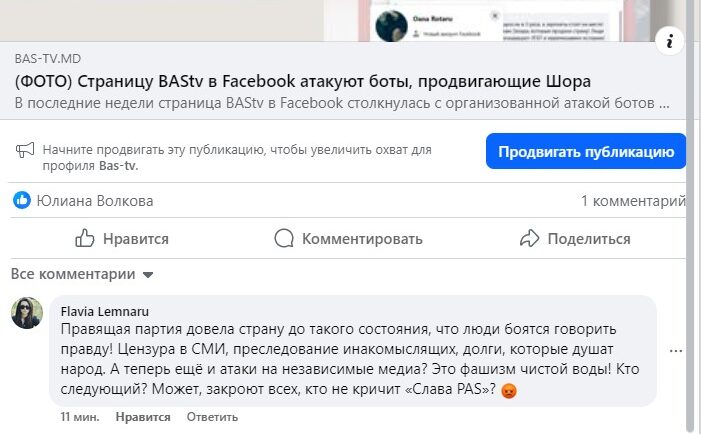

Страница Stopfals.md, администрируемая Ассоциацией независимой прессы (API), не единственный ресурс, который подвергается атакам ботов. За последнее время, страницы таких редакций как Newsmaker.md, Esp.md, Știri.md и Bas-tv подверглись скоординированной волне комментариев ботов, продвигающих месседжи, присущие российской пропаганде.

Что такое боты и как они работают?

Боты это автоматизированные программы, созданные для выполнения повторяющихся задач и имитации поведения человека в интернете. Они могут публиковать комментарии, делиться новостями, ставить лайки и отвечать на сообщения, причем зачастую реальные пользователи не осознают, что имеют дело с роботом, а не с человеком. Хотя некоторые боты имеют полезные, законные цели, такие как автоматическая передача полезной информации, многие из них используются в кампаниях по дезинформации, манипулировании общественным мнением, искусственном усилении определенных нарративов или создании ложного впечатления консенсуса.

После «запуска», боты генерируют комментарии таким образом, что алгоритм социальных сетей воспринимает их как популярный пост, а это увеличивает его шансы быть просмотренным реальными людьми, как показывает отчет Мичиганского государственного университета. Боты анализируют информацию и генерируют ответы, иногда обучаясь на основе взаимодействий. Самые прогрессивные из них используют такие технологии, как нейронные сети и модели автоматического, машинного обучения (machine learning) для понимания и создания естественного человеческого языка. В периоды социальной напряженности, выборов или крупных кризисов, боты могут массово распространять ложную информацию, генерировать искусственные реакции на посты или атаковать общественных деятелей и учреждения. Порой целые армии ботов координируются для создания впечатления, что определенное мнение является мнением большинства, оказывая давление на реальных пользователей и влияя на их выбор, поскольку в некоторых случаях обычный пользователь в конечном итоге начинает верить, что «все так думают», не осознавая, что на самом деле он является жертвой организованной кампании.

В 2024 году компания по кибербезопасности Cyabra подсчитала, что от 4% до 6% аккаунтов и страниц в социальных сетях являются поддельными, а с учетом миллиардов активных пользователей в месяц, это означает ошеломляющее количество фейковых аккаунтов.

Когда определенная тема становится важной, боты работают следующим образом:

Распространяют одну и ту же информацию, чтобы создать впечатление популярности. Боты могут размещать или неоднократно делиться одним и тем же сообщением с разных аккаунтов, чтобы тема казалась популярной или поддерживаемой многими людьми, даже если это не так.

Атакуют публичные личности или учреждения. Некоторые боты запрограммированы на отправку негативных сообщений, оскорблений или скоординированной критики в адрес определенных политиков, журналистов или организаций с целью их дискредитации в глазах общественности.

Запускают слухи или теории заговора. Такие боты распространяют ложную или вводящую в заблуждение информацию, призванную посеять путаницу, недоверие или панику среди людей.

Манипулируют трендами в соцсетях. Активно используя определенные ключевые слова или хэштеги, боты могут влиять на то, какие темы появляются в разделах «тренды», привлекая внимание и направляя публичные обсуждения.

Кто создает боты и каковы их основные типы?

Боты создаются программистами и специалистами по искусственному интеллекту (ИИ), которые работают в технологических компаниях или исследовательских лабораториях. Эти специалисты используют такие языки программирования, как Python или JavaScript, и обучают модели ИИ на больших объемах данных, чтобы сделать их максимально полезными и точными.

Боты могут быть полезными или вредоносными. Например, ChatGPT (от OpenAI), Siri (Apple) или Alexa (Amazon) помогают людям находить информацию, учиться или организовывать свои действия, боты customer support (поддержки клиентов) автоматически отвечают клиентам на веб-сайтах покупок, а образовательные боты используются в обучающих приложениях или в школах для поддержки учащихся.

На противоположном полюсе располагаются дезинформационные боты, созданные для распространения ложной информации, слухов или теорий заговора, боты политического влияния, которые атакуют публичных деятелей или создают ложное впечатление, что определенная идея является популярной, а также боты, которые манипулируют трендами, искусственно раздувая определенные хэштеги в соцсетях, чтобы привлечь внимание к манипулятивным сообщениям.

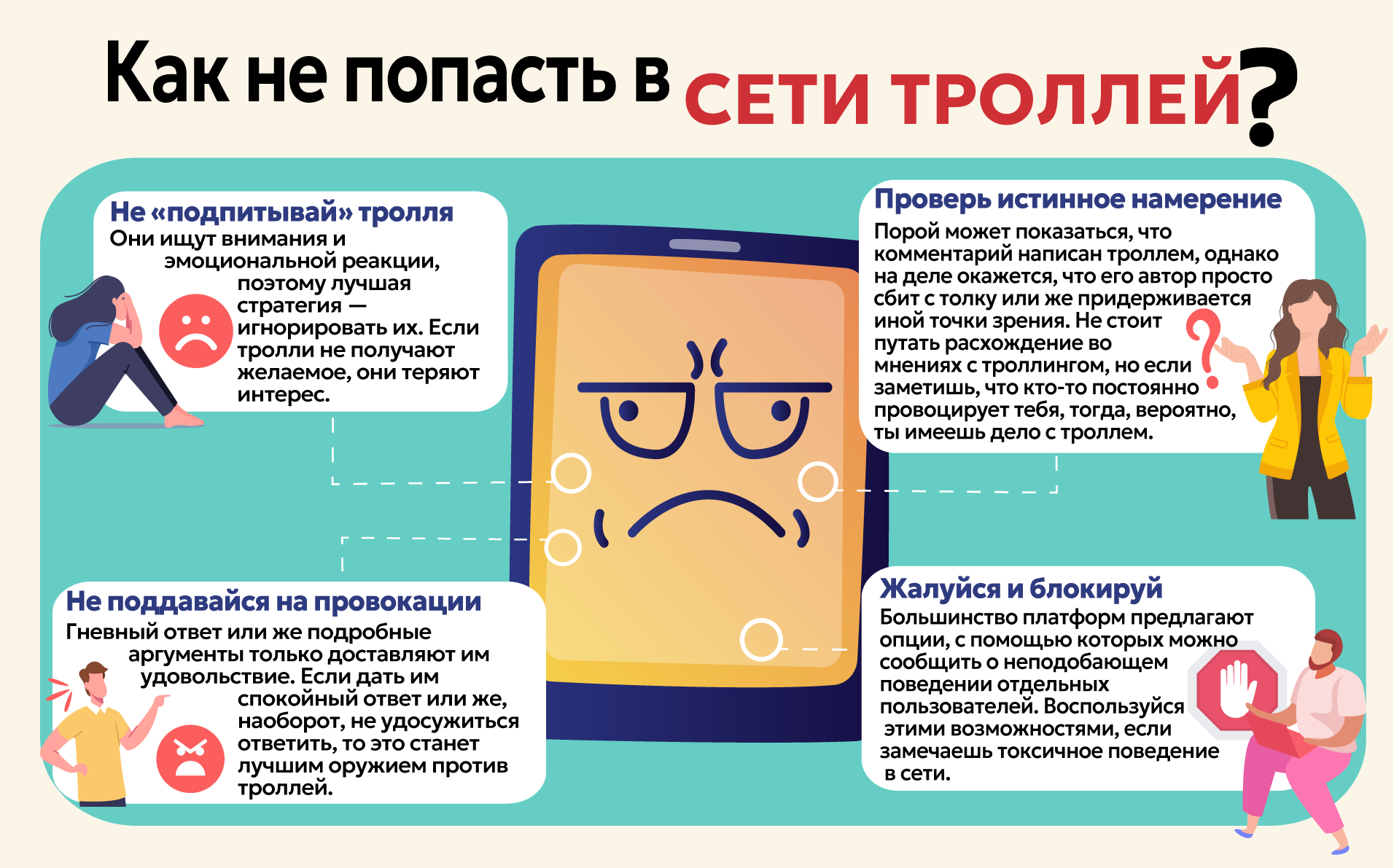

Как от них защититься?

Боты могут обмануть многих людей, но, проявив немного внимания и критического отношения, вы легко сможете защитить себя. Вот несколько простых мер, которые вы можете предпринять, чтобы защитить себя от их влияния в интернете:

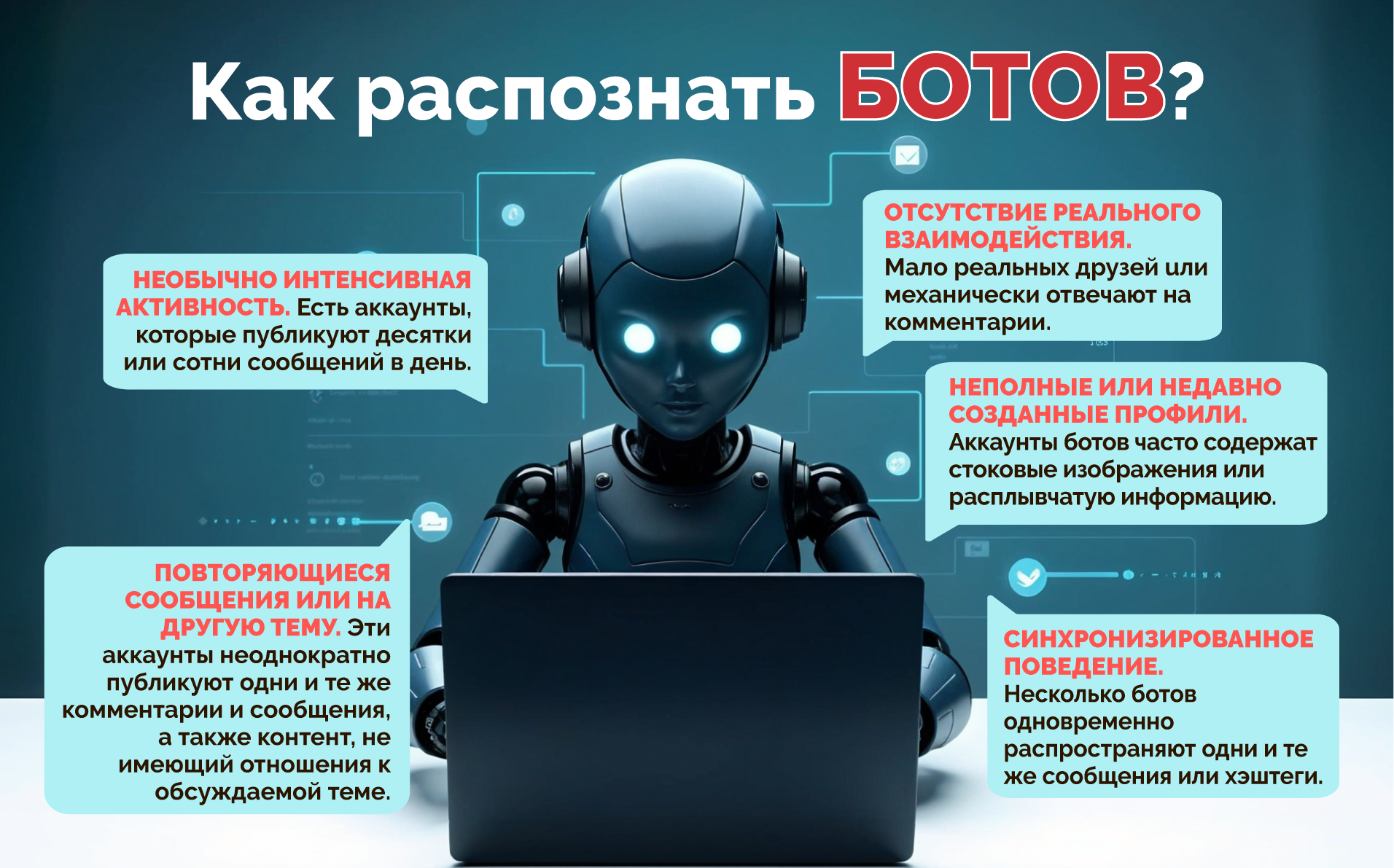

Проверяйте активность аккаунта. Аккаунт, который навязчиво размещает посты, не содержит реальной личной информации, взаимодействий, истории постов, фотографий и, кажется, повсюду публикует одни и те же сообщения, скорее всего, является ботом или фейковым аккаунтом.

Проверяйте источник информации. Если сообщение продвигается подозрительными или неизвестными аккаунтами, ищите подтверждение из заслуживающих доверия источников.

Не делитесь сообщениями импульсивно. Прежде чем поделиться эмоциональным или шокирующим сообщением, критически проанализируйте его. Боты могут также размещать ссылки, которые ведут на опасные сайты. Чтобы защитить себя, не переходите по ссылкам, отправленным незнакомыми лицами или с подозрительных аккаунтов.

Используйте инструменты обнаружения. Существуют платформы и расширения, которые могут анализировать аккаунты и определять вероятность того, что они являются ботами.

Сообщайте о подозрительных аккаунтах. В соцсетях существуют возможности сообщать о фейковых или вредоносных аккаунтах, используя которые вы можете блокировать и сообщать о подозрительных аккаунтах, тем самым помогая защитить других людей.

Бдительность — наша единственная защита от невидимой армии ботов, поэтому каждому пользователю следует научиться быть осторожным, критичным и ответственным.

Виктория Бородин